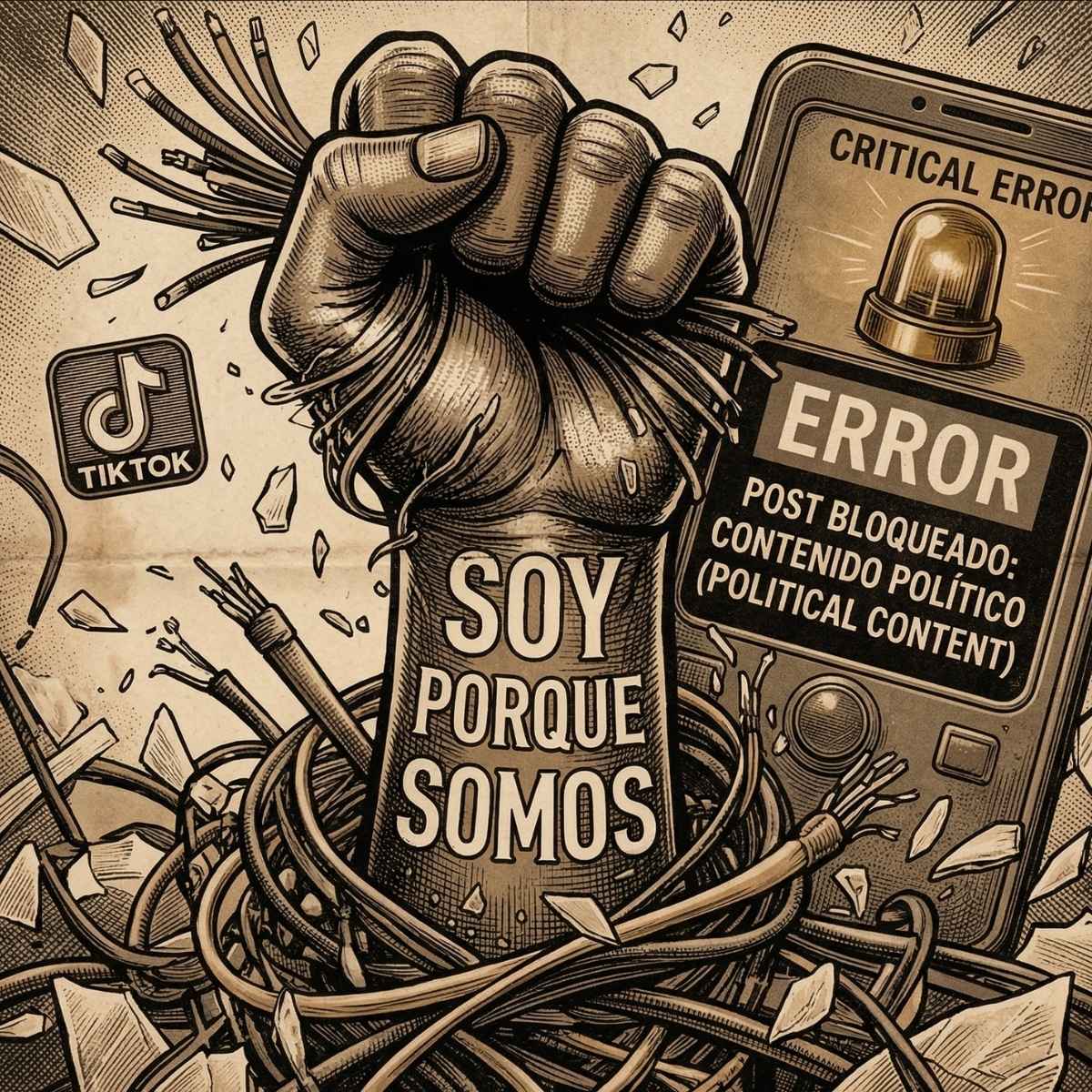

Este artículo surgió mientras me tomaba un café y recibía la notificación de que TikTok había bloqueado en México y Colombia el post sobre el artículo anterior por “contenido político”. Resulta que las ideas de hace cincuenta años siguen siendo peligrosas en los lugares correctos. Así que pensé: si tanto les gusta, ¡vamos a darles una trilogía!

Esta es la noticia

En 1946, Viktor Frankl publicó El hombre en busca de sentido desde los campos de concentración nazis. Su conclusión: incluso en las condiciones más extremas, el ser humano puede encontrar sentido en su interior. La dignidad es individual e indestructible.

En 1961, Frantz Fanon escribió Los condenados de la tierra desde Argelia. Su conclusión fue la contraria: el sufrimiento del colonizado no se resuelve hacia adentro. No hay dignidad individual posible en un mundo diseñado para quitártela. La dignidad se recupera transformando el mundo que la robó.

Dos psiquiatras. Dos guerras. Dos maneras opuestas de entender qué es una persona.

Fuentes: El hombre en busca de sentido, Viktor Frankl, 1946. Los condenados de la tierra, Frantz Fanon, 1961. La invención de África, V.Y. Mudimbe, 1988.

Lo que mi cabeza me dice

La diferencia entre Frankl y Fanon no es de método, sino de ontología. Frankl miró hacia adentro y encontró sentido. Fanon miró hacia adentro y encontró el problema.

La inteligencia artificial ya respondió —sin preguntarte— cuál de los dos tiene razón. Para el algoritmo, el usuario es una unidad, su comportamiento es personal, predecible, clasificable. Hay un “yo” coherente ahí dentro y podemos modelarlo. Frankl ganó por goleada. Pero hay culturas enteras donde ese “yo” no existe como tal. Ubuntu no es el nombre de un sistema operativo ni el eslogan de una campaña de diversidad. Es una ontología viva: “Soy porque somos”. La persona no precede a la comunidad; se constituye en ella.

Cuando un sistema de IA interactúa con una persona y encuentra un comportamiento que no encaja en sus categorías, no cuestiona las categorías: concluye que el error está en la persona.

Aquí entra V.Y. Mudimbe, filósofo congoleño que en La invención de África argumentó que Europa no solo colonizó África económica y psicológicamente, sino también epistemológicamente. Construyó un sistema de conocimiento donde el saber africano no contaba como saber. Su ontología no era filosofía: era folklore.

Ese proceso no terminó con las independencias. Hoy continúa en los modelos de lenguaje entrenados en inglés y con categorías culturales anglosajonas. Cuando procesan lenguas y culturas no occidentales, no las traducen: las colonizan.

Y lo hacen mientras proclaman ser “inclusivos”.

Inclusivos como la imagen generada por IA de la Revolución Francesa con nativos americanos en el fondo porque el modelo aprendió que la diversidad es un accesorio. Inclusivos como el sistema que penaliza ciertas palabras y aprueba otras según criterios de Silicon Valley. Inclusivos como la plataforma que tiene emojis de todos los tonos de piel pero solo entiende el mundo en inglés.

Eso no es inclusión. Es colonialismo con buenas intenciones y mala memoria.

Fanon lo llamó la máscara blanca: el sistema que te hace creer que estás siendo reconocido mientras te obliga a reconocerte en sus términos. En Piel negra, máscaras blancas describió cómo el colonizado termina adoptando el lenguaje, los valores y la forma de entender el mundo del colonizador. No por debilidad, sino porque el sistema recompensa la asimilación y castiga la diferencia.

Hoy, la asimilación se mide en si tu manera de pensar encaja en los patrones que el modelo reconoce como coherentes. Si encaja, eres un usuario normal. Si no, eres ruido que hay que corregir.

Lo más perturbador —lo que Mudimbe añade a Fanon— es que el colonizado termina olvidando que existe otra forma de pensar. Las categorías impuestas se vuelven las únicas posibles. Y cuando eso ocurre en sistemas que procesan millones de interacciones diarias, el olvido se convierte en infraestructura.

Rodney explicó cómo te roban los recursos. Fanon explicó lo que eso le hace a la mente. Mudimbe explicó cómo borran incluso las herramientas para entenderlo.

Lo que los datos dicen

- Hegemonía lingüística. El dataset Common Crawl, columna vertebral de los principales modelos de lenguaje, concentra entre el 45% y el 60% de su contenido en inglés. Sumando español, francés, alemán y mandarín, el bloque occidental y chino absorbe casi todo el entrenamiento. De las más de 7.000 lenguas que existen en el mundo, menos del 0,1% tienen recursos digitales suficientes para entrenar modelos de frontera. Para el algoritmo, lo que no está digitalizado en masa simplemente no existe. Fuentes: Common Crawl; Ethnologue.

- Sesgo WEIRD. Los modelos de lenguaje reproducen marcos culturales de sociedades Occidentales, Educadas, Industrializadas, Ricas y Democráticas (WEIRD). Ante dilemas éticos, priorizan el individualismo y la ética utilitarista. Conceptos como Ubuntu o el Buen Vivir de la región Andina son tratados como curiosidades antropológicas, no como marcos lógicos operativos. Fuentes: Hugging Face; Stanford AI Index, 2025.

- Invisibilidad epistemológica. Menos del 1% de los papers presentados en las principales conferencias de IA como NeurIPS o ICML citan pensadores africanos o filosofías no occidentales como marco teórico. Citar a Fanon o Mudimbe en un artículo técnico roza lo inexistente. Fuente: análisis bibliométrico, 2024.

- El talento se queda. El valor se va. Centros de excelencia como AIMS y CMU Africa gradúan ingenieros de élite, pero el 90% de las patentes y el 80% del empleo de alto nivel en IA en el continente africano pertenecen a laboratorios de Google, Microsoft o Meta. El talento permanece en el territorio. La propiedad intelectual emigra a la nube estadounidense. Fuente: UNESCO, 2024.