Esta es la noticia

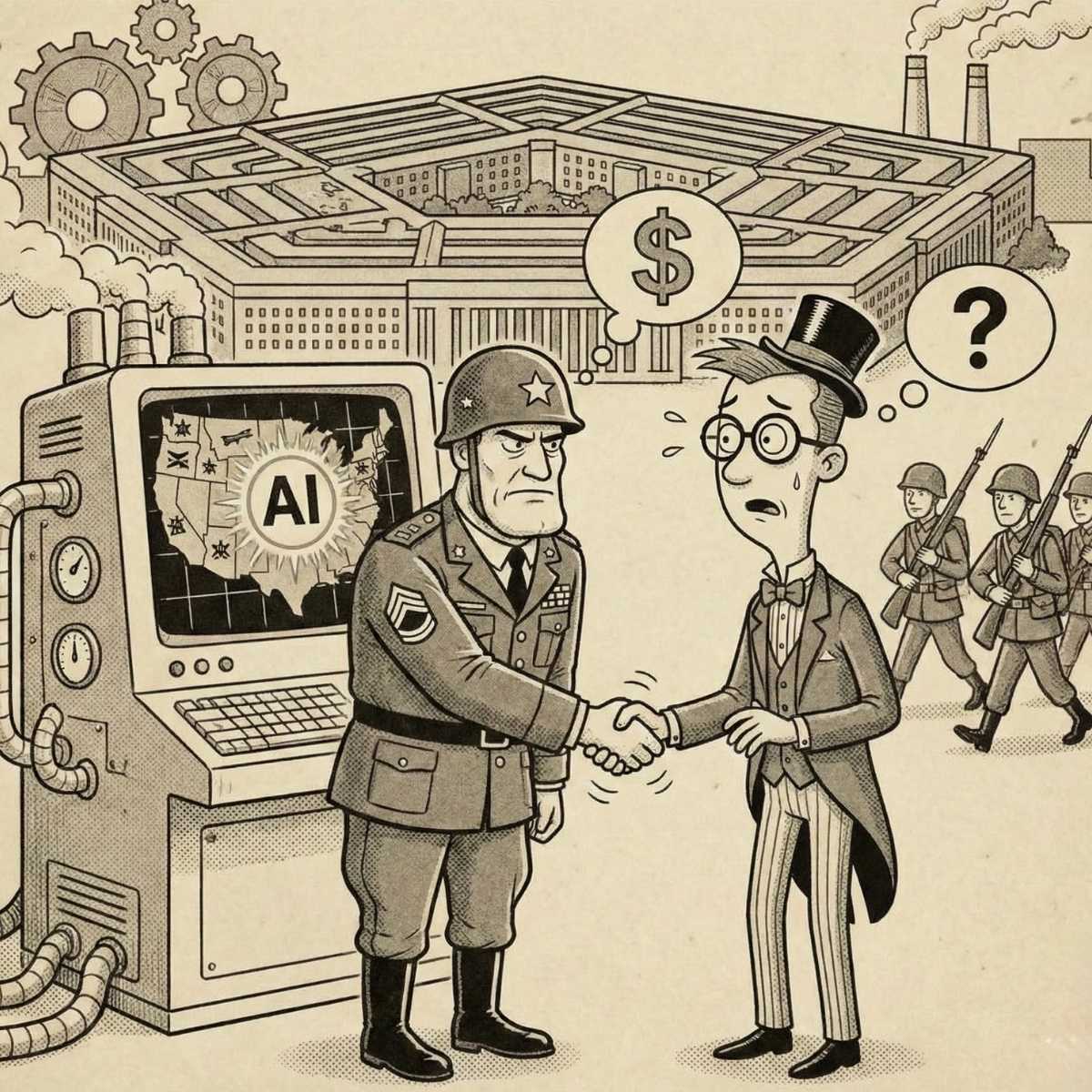

El Departamento de Guerra de Estados Unidos está revisando su relación contractual con Anthropic tras un desacuerdo sobre las condiciones de uso de Claude en entornos militares.

Según informó Axios, el secretario de Guerra, Pete Hegseth, está considerando designar a la compañía como "supply chain risk", una categoría de riesgo en la cadena de suministro que obligaría a los contratistas del Pentágono a dejar de utilizar su tecnología en proyectos vinculados al Gobierno.

El contrato en cuestión ronda los 200 millones de dólares y la relación permanece, por ahora, "bajo revisión", según fuentes oficiales.

Fuente: Axios — Pentagon threatens Anthropic punishment over AI safeguards dispute

Lo que mi cabeza me dice

Conviene desmontar una idea engañosa pero atractiva: pensar que una empresa de inteligencia artificial puede presentarse como protectora de la humanidad y, al mismo tiempo, cobrar cheques del Pentágono sin quedar sometida a las exigencias del Estado, ese Leviatán del que hablaba Hobbes. Eso no es posible.

Anthropic construyó su marca sobre dos líneas rojas inquebrantables: no a la vigilancia masiva de ciudadanos estadounidenses y no a armas completamente autónomas sin supervisión humana significativa. Era el discurso de su folleto. El pitch para inversores y medios que querían creer en una IA "responsable".

Pero el Estado no lee folletos. Sus contratos exigen que la tecnología que adquiere pueda usarse para "todos los fines legales", y eso abarca guerra, espionaje, disuasión nuclear y operaciones especiales como la que capturó a Nicolás Maduro en enero de 2026, donde Claude —vía Palantir— ya corrió por las venas de la "Operación Determinación Absoluta".

Lo que empezó como un contrato de hasta 200 millones de dólares (anunciado en julio de 2025) se ha convertido en una colisión abierta.

El Pentágono, bajo Pete Hegseth, está "cerca" de cortar lazos y etiquetar a Anthropic como "supply chain risk". Una designación que normalmente se reserva para Huawei o Kaspersky, no para un aliado de Silicon Valley. Si se concreta, cualquier contratista del Departamento de Guerra (desde Microsoft hasta boutiques de consultoría) tendría que certificar que no usa Claude. Un misil económico disfrazado de medida de seguridad nacional.

Anthropic, como corporación de beneficio público (PBC), está atrapada en su propia constitución legal: priorizar seguridad y beneficio público choca frontalmente con la lógica del Estado que no negocia soberanía.

El Pentágono no quiere revisar cada caso por separado; lo que busca es un cheque en blanco. Y cuando tu cliente es el Departamento de Guerra, la ética empresarial deja de ser un elemento diferenciador para convertirse en un lujo que sale muy caro.

Con una posible IPO en 2026 y una valoración en el rango de 40–60 mil millones de dólares, la pregunta económica es: ¿vale más ser el "modelo más ético" o el "modelo más útil para el poder"?

Si el Pentágono gana este pulso a Anthropic, el mensaje a inversores será cristalino: la soberanía moral tiene un techo de ingresos muy definido.

Lo que estamos viendo no es un desacuerdo puntual. Estamos ante el ensayo general de cómo se gobierna la IA cuando deja de ser tecnología privada para convertirse en infraestructura de seguridad nacional.

Ya no nos preguntamos si la IA se usará en guerras, porque eso se da por hecho. Ahora la duda es otra: si las corporaciones que desarrollan IA seguirán teniendo algún control sobre sus sistemas o si acabarán convertidas, en la práctica, en una parte más del arsenal del Estado.

Lo que los datos dicen

- Uso operativo en entorno clasificado. Claude es, por ahora, el único modelo de IA de frontera que se está utilizando en redes clasificadas del Departamento de Guerra, por lo que se ha convertido en una pieza clave de la infraestructura militar de Estados Unidos. Fuente: The Wall Street Journal — Pentagon Used Anthropic's Claude in Maduro Venezuela Raid (febrero de 2026).

- Contrato de 200 millones en revisión. El acuerdo entre Anthropic y el Pentágono está siendo reevaluado en medio del desacuerdo sobre las condiciones de uso del modelo. Fuente: Reuters — Pentagon threatens to cut off Anthropic in AI safeguards dispute (15 de febrero de 2026).

- Competencia por contratos autónomos. SpaceX y su filial xAI participan en un concurso del Pentágono valorado en 100 millones de dólares para el desarrollo de enjambres de drones autónomos con control por voz. Fuente: Bloomberg — AI Companies Compete for Pentagon Drone Swarm Contract (febrero de 2026).

- OpenAI en licitaciones de defensa. OpenAI respalda a la startup Applied Intuition en su propuesta para el mismo contrato militar, reforzando su posicionamiento en el sector defensa. Fuente: Bloomberg (2026).

- Diferenciación jurídica estructural. Anthropic opera como corporación de beneficio público (PBC), una figura legal que obliga a la empresa a priorizar explícitamente el interés público junto al retorno económico. Fuente: registro corporativo de Delaware (Delaware Division of Corporations).

- Ingresos empresariales sólidos. Anthropic ha consolidado una base fuerte de clientes empresariales privados, situando sus ingresos anualizados estimados en 14.000 millones de dólares a febrero de 2026, frente a los 1.000 millones de hace apenas catorce meses. Fuente: Sacra Research (2026).